最近、チャットとかで「AIエージェント」って言葉、めっちゃ見かけません?🤔 なんかスゴそうだけど、正直「ChatGPTと何が違うの?」って思ってる人も多いんじゃないかなって。僕も最初はそうでした😂

今日はその辺のモヤモヤを、僕なりに整理してみようかなって思います。2025年にもなって、このトレンドはもう無視できない感じなので、ちょっとだけ付き合ってもらえると嬉しいです!

じゃ、AIエージェントって一体何者?

一言でいうと、AIエージェントは「考えて、自分で動いてくれるAI」って感じです。超優秀なアシスタントみたいな存在かな。

ChatGPTとかって、こっちが質問やお願いをしたら、それに答えてくれる「相談相手」じゃないですか。 「この記事の要約作って」って言ったら要約をくれるし、「面白いキャッチコピー考えて」って言ったら考えてくれる。でも、そこまで。その先のアクションは、こっちがやらないといけない。

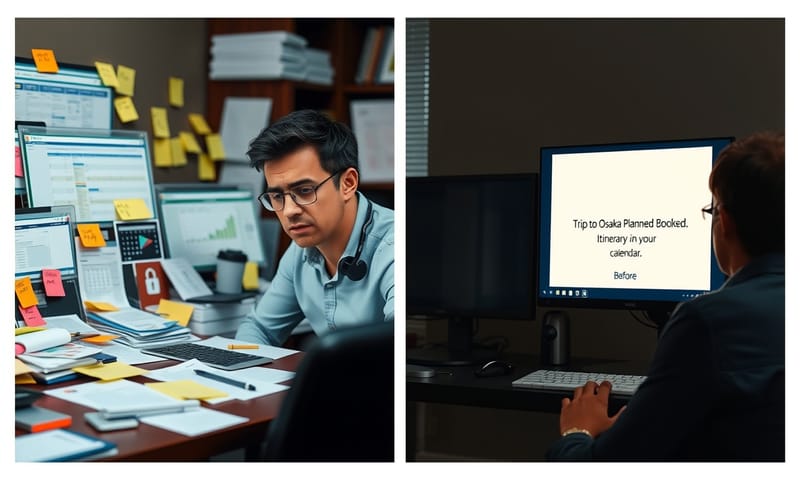

でも、AIエージェントは違うんです。「来週の出張、計画しといて」ってお願いしたら、自分でフライト調べて、ホテル探して、カレンダーに予定入れて…みたいな、一連のタスクを自律的にやってくれるイメージ。 まさに「代理人(エージェント)」ってわけです。

専門的に言うと、「環境を認識して、計画を立てて、行動する」っていうサイクルを自分で回せるAIのこと。 人間の介入がなくても、目標に向かって自分でどんどんタスクを進めてくれるのが最大の特徴ですね。

ChatGPTと何が決定的に違うの?

ここが一番知りたいポイントですよね。僕も最初はごっちゃになってました。一応、ChatGPTも「AIエージェント」の一種と見ることもできるらしいんですけど、一般的にはその「自律性」で区別されてます。 簡単に表にまとめてみました。

| 比較ポイント | ChatGPT (従来の生成AI) | AIエージェント |

|---|---|---|

| 役割 | 相談役、壁打ち相手 🧠 | 実行役、タスク担当者 🏃♂️ |

| 得意なこと | 質問に答える、文章を作る、要約する。一回のやり取りで完結するタスク。 | 目標を与えると、自分で計画を立てて、ウェブ検索やアプリ操作などを連続して実行する。 |

| やりとりの流れ | 「これやって」→「はい、できました」で一旦終わり。次は何をするか人間が考える。 | 「この目標を達成して」→(自律的にタスクを分解・実行…)→「目標、達成しました」と報告。 |

| たとえるなら… | 超物知りなコンサルタント。アドバイスはくれるけど、実行は自分。 | 優秀なプロジェクトマネージャー兼プレイヤー。丸っと任せられる。 |

| 具体例 | 「東京のおすすめラーメン店を5つ教えて」→リストをくれる。 | 「東京で評価4.5以上のラーメン店を調べて、今から一番早く行ける店を予約して」→調べて予約まで完了させる。 |

どうでしょう?こう見ると、全然役割が違うのがわかりますよね。ChatGPTが「頭脳」だとしたら、AIエージェントは「頭脳と手足」を両方持ってる感じです。だから、ガートナーみたいな調査会社も、2025年の重要な技術トレンドとして挙げてるみたい。

最近よく聞く「あの」ツールも、実はエージェントだったりする

最近、本当にいろんなAIエージェントが出てきてますよね。特に2024年から2025年にかけて、すごい勢いです。

- 営業・マーケティング支援: 顧客リストの作成からメール送信、アポ獲得までを自動でやってくれるエージェント。 企業の商談獲得をサポートしてくれるみたいです。

- ソフトウェア開発: 「こういうアプリ作って」って言うだけで、自分でコードを書いて、デバッグして、完成させちゃうみたいな「AIエンジニア」。Devinが有名になりましたけど、似たようなツールがどんどん出てます。

- 採用活動: AIが面接官になって一次面接をやったり、候補者のスクリーニングをしたり。 人事の仕事も大きく変わりそう。

- 日常生活: 旅行の計画やレストランの予約、複雑な情報収集と整理なんかも、どんどん任せられるようになってきてます。

日本国内でも、JAPAN AI株式会社が「JAPAN AI AGENT」っていうのを発表してて、営業とかマーケティング、経理みたいな職種ごとに特化した実用的なエージェントを提供しようとしてるみたいです。 こういう日本企業向けのサービスは、海外のものと違って日本の商習慣とかを理解してくれてるのが強みになりそうですね。

ぶっちゃけ、私たちの生活にどう関係してくるの?

「で、結局それって私たちの生活や仕事にどう影響するの?」って話ですよね。正直、かなり大きな変化が来ると思ってます。

良い面で言うと、とにかく「めんどくさい作業」から解放されること。 例えば、毎月の経費精算とか、いろんなサイトを見比べて作る出張レポートとか、そういうのを「やっといて」の一言で済ませられるようになるかもしれません。 そうなったら、もっとクリエイティブな仕事とか、本当に頭を使わないといけないことに集中できるようになりますよね。 企業からしたら、生産性がめちゃくちゃ上がるわけです。

でも、ちょっと怖い面もあって。AIエージェントは自律的に動くから、もし間違った判断をしたら、勝手に間違った予約をしちゃったり、間違ったメールを送っちゃったりするリスクもあるわけです。 だから、どうやってAIエージェントを管理・監督していくか、っていうルール作りがすごく大事になってくると思います。

個人的に注目してるのは、この辺の進化

僕が個人的にワクワクしてるのは、「マルチエージェントシステム」っていう考え方です。 これは、一つのタスクを、それぞれ専門分野を持つ複数のAIエージェントが協力して解決するっていうもの。

例えば、「新商品のプロモーション企画を立てて実行して」ってお願いしたら、

- リサーチ担当エージェントが市場調査をして、

- プランニング担当エージェントが企画書を作って、

- クリエイティブ担当エージェントが広告の画像やコピーを作って、

- 実行担当エージェントがSNSに投稿したり広告を出したりする…

みたいな。まるでAIでできたプロジェクトチームみたいですよね。これが当たり前になったら、仕事の進め方が根底から変わる気がします。

あとは、AIエージェントがもっと「プロアクティブ」になること。 こっちが指示しなくても、「来週の天気、雨が多いみたいなので、室内で楽しめる週末プランをいくつか提案しておきました」みたいに、先回りして動いてくれる。まさにデジタルなパートナーって感じです。 ここまで来ると、もうただのツールじゃなくて、本当に「仲間」って感じがしますよね。

AIエージェントは、まだ始まったばかりの技術だけど、その進化のスピードはめちゃくちゃ速いです。2025年は、まさに「AIエージェント元年」って感じがしますね。 これからどんな風に僕たちの生活を変えてくれるのか、目が離せません!🚀

みんなは、もし完璧なAIエージェントがいたら、最初に何をお願いしてみたいですか?よかったらコメントで教えてください!