最近考えてたんだけど、AIのモデル構造を「グラフ」で表現するって話、よく聞くじゃない?正直、最初は何がそんなに画期的なのか、いまいちピンと来てなかったんだよね。なんか数学的で難しそうだし。でも、ちょっと調べてみたら、これ、めちゃくちゃ強力な考え方だってことが分かってきた。

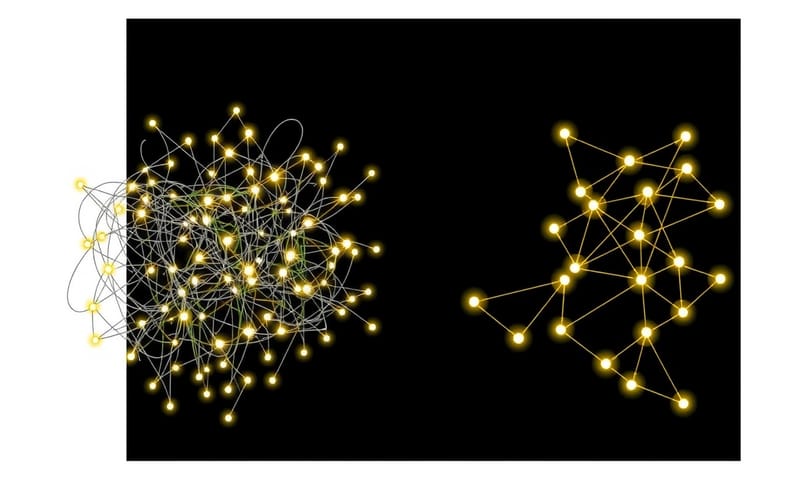

要するに、複雑に絡み合った変数たちの関係性を「見える化」するための地図みたいなもの。どの変数がどの変数に直接影響を与えているのかが一目でわかるようになる。これがないと、何十個もの要素がごちゃごちゃになったシステムなんて、理解するだけで日が暮れちゃうからね。

先說結論

グラフモデルっていうのは、AIが「考える」ための設計図を、人間が直感的に理解できる絵(グラフ)に落とし込む技術。特に、変数が多くて関係性が複雑な問題で、計算量を爆発的に減らしてくれるのがマジでありがたい。これのおかげで、昔は不可能だった規模のモデルが作れるようになったりする。

案例/證據:リレーで考えてみると超わかる

言葉で説明するより、具体的な例で見たほうが絶対早い。たとえばさ、3人のランナー、アリス、ボブ、キャロルでリレーをするところを想像してみて。

- アリスが第一走者。彼女のゴールタイムが

t₀。 - ボブはアリスからバトンを受け取って走る。彼のゴールタイムが

t₁。 - キャロルはボブからバトンをもらってアンカー。彼女のタイムが

t₂。

この時、それぞれのタイムの関係ってどうなってる?

ボブのタイムt₁は、アリスのタイムt₀に直接影響されるよね。アリスが遅れれば、ボブのスタートも遅れるから。同じように、キャロルのタイムt₂は、ボブのタイムt₁に直接影響される。でも、アリスのタイムt₀が、キャロルのタイムt₂に「直接」影響することはない。あくまでボブを介して、「間接的」に影響するだけ。この関係、矢印で書くとすごくスッキリする。

アリス (t₀) → ボブ (t₁) → キャロル (t₂)ほら、これだけで「影響の流れ」が一目瞭然。これが有向グラフモデル、よく「ベイジアンネットワーク」とか呼ばれるやつの一番シンプルな形。この矢印が、モデルの構造そのものなんだよね。

怎麼做:で、これって数学的にどういうこと?

この「矢印」が、数学の世界、特に確率の世界でとんでもないパワーを発揮する。さっきのリレーの例で、3人の合計タイムの確率を計算したいとする。普通に考えたら、「アリスとボブとキャロルのタイムの組み合わせ」全部を考えなきゃいけない。これを数式で書くと p(t₀, t₁, t₂) みたいになる。

でも、グラフ構造(あの矢印の図)を使うと、この式を分解できるんだ。

p(t₀, t₁, t₂) = p(t₀) × p(t₁|t₀) × p(t₂|t₁)うわ、なんか難しそう…って思うかもしれないけど、落ち着いて。これはただ、さっきの直感を数式にしただけ。

p(t₀):アリスのタイムが決まる確率。彼女は最初の走者だから誰にも影響されない。p(t₁|t₀):アリスのタイムt₀が分かった「条件で」、ボブのタイムt₁が決まる確率。矢印の通り。p(t₂|t₁):ボブのタイムt₁が分かった「条件で」、キャロルのタイムt₂が決まる確率。これも矢印の通り。

つまり、「全員の組み合わせを一度に考える」んじゃなくて、「それぞれの走者は、前の走者のことだけ考えればいい」っていう、リレーのルールそのものに変わったわけ。キャロルはアリスのことまで気にしなくていい。これが「条件付き独立性」っていう考え方のキモで、グラフモデルが賢い理由。

計算量がマジで劇的に減る話

この「分解できる」ってのが、どれだけすごいことか。具体的な数字で見てみよう。仮に、各ランナーのタイムが0分から10分まで、6秒刻みで100通りの可能性があるとする。

もしグラフ構造を使わなかったら…

3人のタイムの組み合わせは 100 × 100 × 100 = 1,000,000通り。つまり、同時確率分布 p(t₀, t₁, t₂) を表すテーブルを作ろうとしたら、100万個近い値を保存しなきゃいけない。変数が1個増えるたびに、必要なパラメータ数が100倍になる。死ぬよね、普通に。

でも、グラフ構造を使ったら…

p(t₀)のテーブル:アリスのタイムのパターンだから、100個の値で済む。(正確には99個)p(t₁|t₀)のテーブル:アリスの各タイム(100通り)に対して、ボブのタイム(100通り)が決まるので、100 × 100 = 10,000個。(正確には9,900個)p(t₂|t₁)のテーブル:ボブの各タイム(100通り)に対して、キャロルのタイム(100通り)が決まるので、これも10,000個。(正確には9,900個)

全部足しても、100 + 10,000 + 10,000 で、だいたい2万個くらい。100万個と2万個。全然違うでしょ? パラメータの数が50分の1になった。変数がもっと増えれば、この差は天文学的なレベルになる。これが、グラフモデルが複雑なシステムを扱える秘密。

情境變體:「向き」があるグラフと、ないグラフ

ここまで話してきたのは、矢印に「向き」がある「有向グラフモデル(ベイジアンネットワーク)」の話。でも、世の中には向きがハッキリしない関係性もたくさんある。そういう時は、「無向グラフモデル(マルコフネットワーク)」っていうのを使う。

この2つ、どう使い分けるのか、ちょっとまとめてみた。

| 種類 | 有向モデル (ベイジアンネットワーク) | 無向モデル (マルコフネットワーク) |

|---|---|---|

| グラフの見た目 | エッジに矢印がある (A → B) | ただの線 (A - B) |

| 表現するもの | 因果関係や時間的な流れ。「原因→結果」みたいな、一方向の関係性を表現するのが得意。 | 相互依存関係や、単なる相関。「どっちが原因とか言えない、お互い様」みたいな関係の時に使う感じ。 |

| 得意な例 | さっきのリレーの話みたいに、プロセスが順番に進むやつ。病気の診断(症状→病名)とか。 | 画像処理で隣り合うピクセルの関係とか。SNSで友達同士の関係とか(AがBの友達なら、BもAの友達、みたいな)。 |

| 個人的な一言 | ストーリーが作りやすいから、人に説明する時にめっちゃ便利。物事の「流れ」をモデル化したいならこっち。 | 関係性がごちゃっとしてて、どこから手をつけていいか分からない時に、とりあえず相関の強いやつを線で結んでみる、みたいな使い方も。 |

この辺の話は、クリストファー・ビショップの名著『Pattern Recognition and Machine Learning』 (PRML) とか読むと、本当に詳しく書いてある。…正直、最初は数式だらけでとっつきにくいけどね(笑)。でも、この考え方自体は、もっと身近なところでも応用されてる。

例えば、日本のECサイトの推薦エンジンとか。ユーザーの閲覧履歴、購入履歴、カートに入れた商品…これらの関係性って、必ずしも「Aを見たからBを買った」みたいな単純な因果関係だけじゃないよね。「この商品を買う人は、だいたいこっちのカテゴリも見てる」みたいな、もっとフワッとした相互依存関係だったりする。こういうのをモデル化するのに、マルコフネットワークの考え方が役立ってるはず。

限制/失敗:グラフモデルも万能じゃない

ここまで聞くと、グラフモデル最強じゃん!って思うかもしれないけど、もちろん限界もある。大事なのは、グラフが「何をしてくれて」「何をしてくれないか」を理解しておくこと。

グラフが教えてくれること:

- 変数間の「依存関係の骨格」。つまり、「どの変数がどの変数に関係しているか」だけ。

- 条件付き独立性の仮定。矢印がないってことは、「この二つは直接関係ないって仮定しますよ」っていう宣言。

グラフだけじゃ分からないこと(自分で定義しなきゃいけないこと):

- 関係性の「性質」:AがBに影響するとして、それは線形な関係?それとももっと複雑な非線形な関係?

- 関係性の「強さ」:影響の度合いはどれくらい?ちょっとだけ?それともめちゃくちゃ強く?これはパラメータで決まる。

- 具体的な確率分布の形:例えば、リレーの例で「ボブの走力はアリスの調子とは無関係」だと仮定しても、ボブのゴールタイム

t₁はアリスのスタート援助t₀に依存する。この依存関係をどんな数式(条件付き確率分布)で表現するかは、グラフの外で決めないといけない。

要するに、グラフはあくまで「モデルの構造」っていう骨組みを見せてくれるだけで、その中身の肉付け…つまり、具体的な計算方法は、分析者がちゃんと考えて設計してあげる必要があるんだよね。

じゃあ、結局何が嬉しいんだっけ?

色々話してきたけど、結局のところグラフモデルの良さは、複雑なものを「構造化して思考する」ための強力なツールだってことだと思う。ごちゃごちゃした現実の問題を、スッキリした依存関係のマップに落とし込むことで、

- システム全体を俯瞰して理解できる。

- 計算量を現実的な範囲に抑えられる。

- モデルがどんな仮定を置いているのか、他の人にも説明しやすくなる。

単なる数学的なテクニックというよりは、むしろ「思考の補助輪」みたいなものかもしれない。複雑な問題に直面した時、「これをグラフで書いたらどうなるかな?」って一度考えてみるだけで、見えなかった道筋が見えてくることがある。それって、すごく価値のあることだと思うんだ。

身の回りで、こういう「Aが起きるとBが起きて、それがCに影響する」みたいな連鎖、何か思いつきますか?例えば、料理の手順とか、仕事のワークフローとか。もし何か面白い例を思いついたら、よかったらコメントで教えてください!